据IEEE Spectrum报道,两年前,苏黎世大学Davide Scaramuzza实验室的机器人专家,使用安装在徒步旅行者头部的摄像机拍摄的一组照片来训练深度神经网络,然后,它可以使无人机能够沿着森林里的路径飞行,而不撞上任何东西。之所以能够安全飞行,其原因在于,使用这种技术可以让无人机具有最小的机载传感以及完全自主计算功能。并且,不用专门收集以无人机为中心的数据来训练深度神经网络。

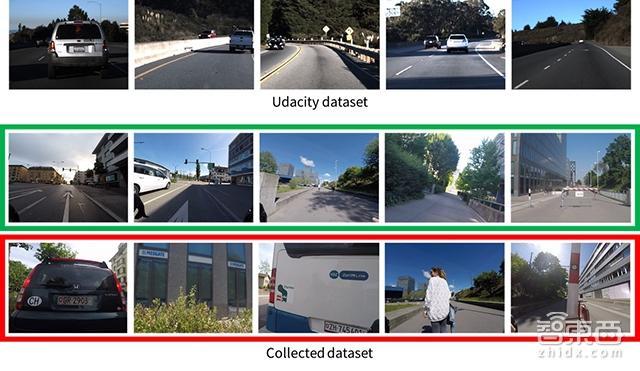

近期在IEEE机器人与自动化通讯出版的一篇新论文中,苏黎世大学机器人与感知组负责人Scaramuzza教授和他的一个博士学生Antonio Loquercio,以及来自西班牙马德里大学的合作者Ana I. Maqueda和Carlos R. del-Blanco介绍了一些新的研究进展,他们利用汽车和自行车收集的数据来训练深度神经网络,它可以使无人机在城市街道上自由飞行。

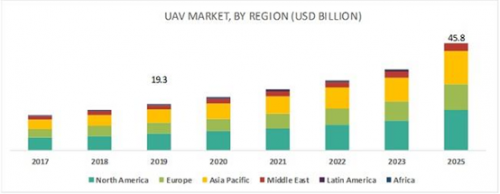

大多数的自主无人机(和一般的自主机器人)都不使用预存的地图进行导航,而是使用某种可以将定位和映射同步的功能,或是如研究人员所说的“地图定位计划”,即创建一个地图,并在这个地图上进行定位,然后规划安全的行走路线。但是这需要比较大且复杂的计算机以及非常昂贵且耗电的传感器。如果要把无人机商业化,这种方法是不可行的。

幸运的是,通过数据进行驱动来替代所有硬件的方法是可行的。给定一个足够大的数据集,可以对做事的方式进行正确的预测,利用这个功能就可以对深度神经网络进行训练,使其能够对人类的简单指令做出回应。然而,在像城市这样真实繁忙的环境中收集数据是不太可能的。但目前,在这一方面已经有了大量数据,这就要归功于自动驾驶汽车的发展。

然而,这些数据不适合训练无人机,虽然它们包括了摄像机图像与转向角相关联的数据,但是,却没有包括摄像机图像与碰撞之间相联系的概率数据。对此,Scaramuzza教授和他的同事通过把GoPro(极限运动专用相机)放在一辆自行车上来收集那些未经破解的数据。

使用这些汽车数据集和自行车数据集来训练卷积神经网络DroNet,它能够使无人机安全的穿越城市街道。

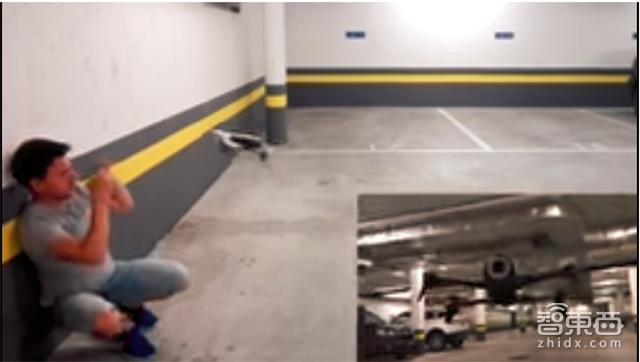

此外,通过输入单目摄像机的图像,DroNet能够控制任何一架无人机,使其可以在生活场景中以特定的转向角和速度前进。并且,在可能发生碰撞时,无人机可以对速度进行自动调节。此次训练的所有数据都来自户外环境,但研究人员发现,即使没有对室内数据进行训练,它也可以在这些环境中做的很好,比如在建筑物和车库里。

有关详细信息,我们通过电子邮件与苏黎世大学机器人与感知组负责人Scaramuzza教授进行交谈:

IEEE Spectrum:您可以讲述一下这项研究对几年前直升机的森林导航功能有什么改进的地方吗?

Davide Scaramuzza:在这项工作中,DroNet采取了完全不同的方法。事实上,之前的神经网络只是能够识别出一条路径,然后输出采取离散行动的指令(中心、左边、右边)。相比之下,DroNet可连续输出控制指令,这样就可以使无人机飞行的更加平稳。此外,DroNet也可以识别出危险情况,如当有行人或自行车通过时,可以命令无人机停止飞行。

IEEE Spectrum:那DroNet都可以应用在什么场景之下?你们展示了它在停车场和室内的运行情况,那在不同的环境中会有什么挑战?您的算法是否会遇到麻烦或者出现不能够使用的情况?

Davide Scaramuzza:这个应用范围已经在视频中被广泛的展示出来了。甚至有时候我们对于它能够在实际中做得那么好都感觉非常惊讶。我们正在试图解释这种情况,并且我们还发现神经网络能够对具有“线状”特征的环境做出特定的反应。例如街道、停车场、室内走廊以及所有其他具有线条特征的环境等。

然而,那些带有线条特征的地方并不能代表它的运动方向,或者在某些线条特别密集的地方也会给DroNet带来挑战。比如,当把无人机放在没有一条清晰路线的森林中时,它就不能够正常工作。

IEEE Spectrum:在新闻稿中,研究小组警告说人们对于这样轻便、廉价的无人机期望值过高。那你们说的对无人机的期望值是什么?应该对这些无人机有什么期待?

Davide Scaramuzza:目前这些只是初步的研究成果。而且深度神经网络也只能输出一个转向角和一个碰撞概率。因此,无人机的运动被限制在一个恒定的高度上。此外,它也不能够和其它功能进行集成,比如探索功能。

但是,通过这项研究,我们想要展示一个浅层的神经网络究竟能够应用在哪些方面(DroNet只需要使用一个简单的CPU,而不需要一个非常耗电的GPU)。因此,我们取得的研究成果都可以应用在很多资源受限的平台,甚至可以应用在纳米无人机上,使其可以再城市环境中进行导航。

IEEE Spectrum:你们接下来的研究方向是什么?

Davide Scaramuzza:我们接下来的目标是希望无人机能够更加灵活敏捷,并消除2D运动限制。此外,我们也希望无人机能够更加智能,可以像鸟一样四处飞行并进行精确导航。